借助 Gemini Nano,您无需网络连接或将数据发送到云端,即可提供丰富的生成式 AI 体验。对于您主要关注低成本和隐私保护的使用情形,设备端 AI 是一项出色的解决方案。

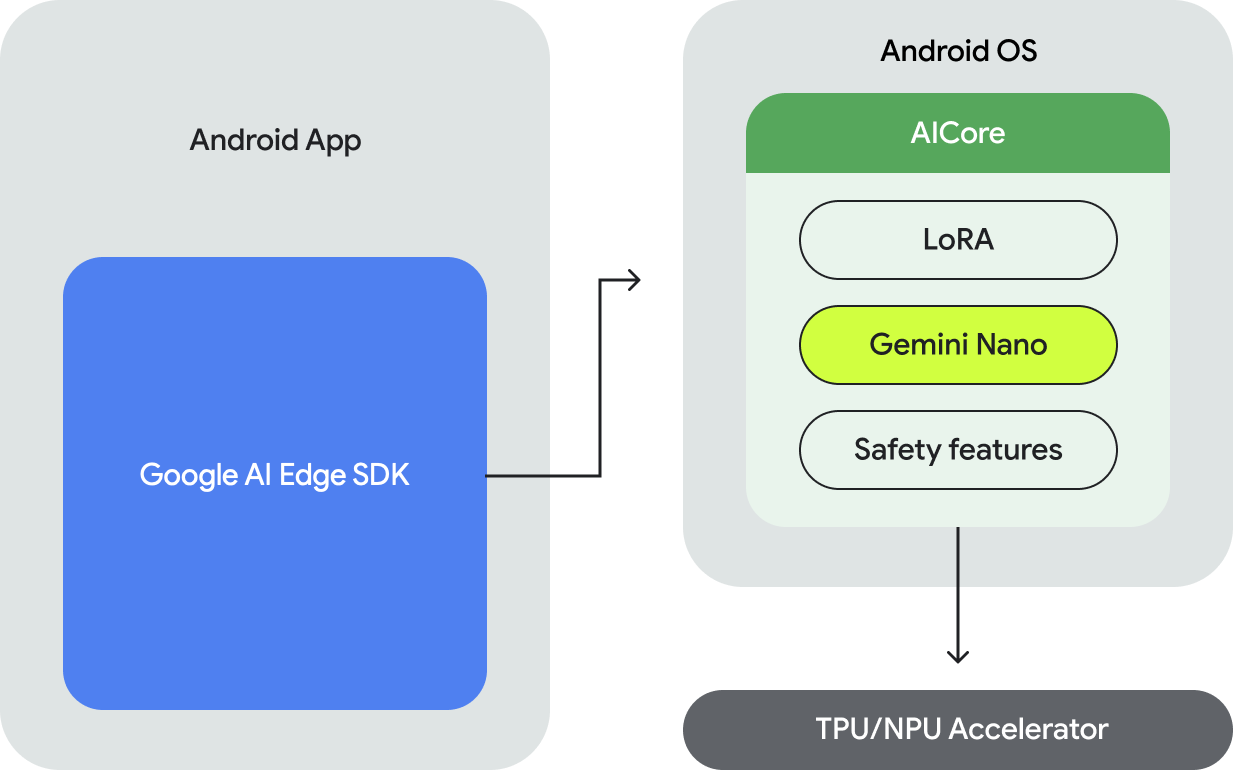

对于设备端应用场景,您可以利用 Google 的 Gemini Nano 基础模型。Gemini Nano 在 Android 的 AICore 系统服务中运行,该服务利用设备硬件来实现低推理延迟,并使模型保持最新状态。

机器学习套件生成式 AI API

机器学习套件的生成式 AI API 可利用 Gemini Nano 的强大功能来帮助您的应用执行任务。这些 API 通过高级接口为热门使用场景提供开箱即用的优质体验。机器学习套件生成式 AI API 基于 AICore 构建,AICore 是一项 Android 系统服务,可实现生成式 AI 基础模型的设备端执行,从而通过在本地处理数据来增强应用功能并提升用户隐私保护。了解详情。

主要功能

机器学习套件生成式 AI API 支持以下功能:

- 提示:根据自定义的纯文本提示或多模态提示生成文本内容。

- 总结:以项目符号列表的形式总结文章或对话。

- 校对:校对简短的聊天消息。

- 重写:以不同语气或风格重写简短的对话消息。

- 图片说明:生成指定图片的简短说明。

- 语音识别:将口头音频转写为文本。

通过 AICore 实现的架构

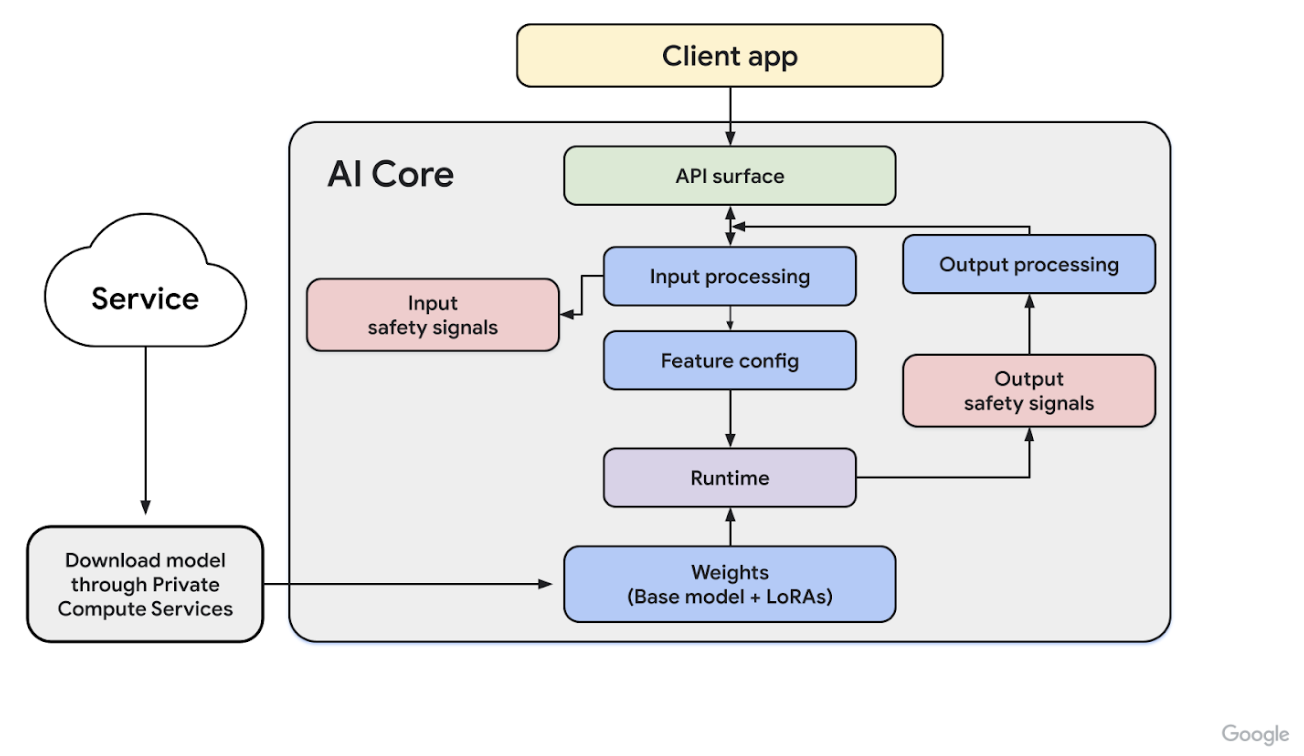

作为系统级模块,您可以通过一系列 API 访问 AICore,以便在设备上运行推理。此外,AICore 还具有多项内置安全功能,可确保针对我们的安全过滤器进行全面评估。下图概述了应用如何访问 AICore 以在设备上运行 Gemini Nano。

确保用户数据的私密性和安全性

设备端生成式 AI 在本地执行提示,无需调用服务器。 虽然这样可以消除网络延迟,但推理速度取决于设备硬件。 这种方法可将敏感数据保留在设备上,从而增强隐私保护,同时还可实现离线功能并降低推理成本。

AICore 遵循 Private Compute Core 原则,具有以下主要特征:

- 受限的软件包绑定:AICore 与大多数其他软件包隔离,仅对特定系统软件包有少数例外情况。对该许可名单的任何修改只能在完整的 Android OTA 更新期间进行。

- 间接互联网访问:AICore 不具备直接互联网访问权限。 所有互联网请求(包括模型下载)都通过开源 Private Compute Services 随附 APK 进行路由。Private Compute Services 中的 API 必须明确展示其以隐私保护为中心的设计理念。

此外,AICore 在设计时就考虑到了隔离每个请求,并且在处理输入数据或生成输出结果后,不会存储任何相关记录,以保护用户隐私。如需了解详情,请参阅博文 Gemini Nano 隐私权和安全性简介。

通过 AICore 访问 AI 基础模型的优势

AICore 使 Android 操作系统能够提供和管理 AI 基础模型。这可显著降低在应用中使用这些大型模型的成本,主要原因如下:

- 易于部署:AICore 可管理 Gemini Nano 的分发并处理未来的更新。您无需担心通过网络下载或更新大型模型,也不会影响应用的磁盘和运行时内存预算。

- 加速推理:AICore 利用设备端硬件来加速推理。您的应用可在每台设备上获得最佳性能,并且您无需担心底层硬件接口。