大语言模型 (LLM) 的功能各不相同。为了让您在 AI 辅助软件开发中拥有控制权和灵活性,Android Studio 允许您选择在个人机器上运行的本地模型,以支持 IDE 的 AI 功能。

选择模型

本地模型可替代 Android Studio 内置的 LLM 支持;不过,由于功能强大的 Gemini 模型,因此 Android Studio 中的 Gemini 通常可为 Android 体验提供最佳 AI。您可以为 Android 开发任务选择各种 Gemini 模型,包括免费的默认模型或通过付费 Gemini API 密钥访问的模型。

如果您需要离线工作、必须遵守有关 AI 工具使用的严格公司政策,或者有兴趣尝试开源研究模型,那么本地模型功能是一个不错的选择。

试用 Gemma 4 模型

如果您需要使用本地模型,我们建议您试用 Gemma 4,这是一款 先进的本地模型,可在 Android Studio 中用于智能体编码。

硬件要求如下。如果您拥有高性能机器,我们建议您使用 Gemma 26B MoE 模型。

| 模型 | 所需 RAM 总量 | 存储空间 |

|---|---|---|

| Gemma E4B | 12 GB | 4 GB |

| Gemma 26B MoE | 24 GB | 17 GB |

如需了解如何在本地机器上 下载和运行 Gemma 4,请参阅设置指南。

设置本地模型支持

下载并安装 最新版本的 Android Studio。

将模型提供商添加到 Android Studio。

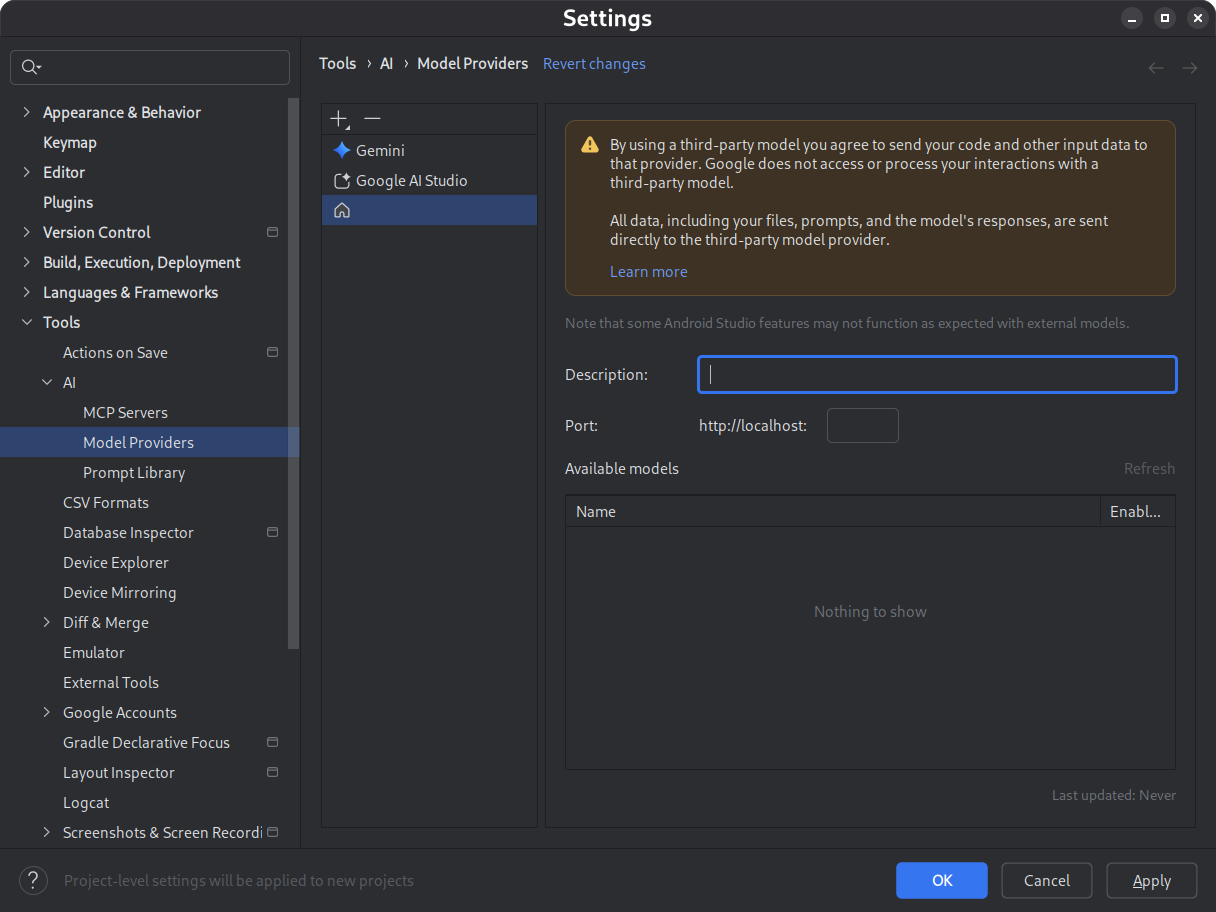

- 依次前往设置 > 工具 > AI > 模型提供商

- 选择 图标

- 选择本地提供商

- 输入模型提供商的说明(通常是模型提供商的名称)

- 设置提供商正在监听的端口

- 启用模型

图 1.模型提供商设置。 下载并安装您选择的模型。

请参阅 LM Studio 和 Ollama 模型目录。为了在 Android Studio 中获得最佳智能体模式体验,请选择经过工具使用训练的模型。

图 2.可用的本地模型。 启动推理环境。

推理环境可为本地应用提供模型。配置足够大的上下文长度令牌窗口,以获得最佳性能。 如需有关启动和配置环境的详细说明,请参阅 Ollama或 LM Studio文档。

选择模型。

打开 Android Studio。前往 Gemini 对话窗口。使用模型选择器从默认 Gemini 模型切换到您配置的本地模型。

图 3.模型选择器。

将 Android Studio 连接到本地模型后,您可以在 IDE 中使用聊天功能。所有互动都完全由在本地机器上运行的模型提供支持,为您提供独立的 AI 开发环境。

考虑性能限制

本地离线模型的性能或智能性通常不如基于云端的 Gemini 模型。与基于云端的模型相比,本地模型的聊天响应通常不太准确,延迟也更高。

本地模型通常不会针对 Android 开发进行微调,并且本地模型可能会返回与 Android Studio 界面无关的响应。某些 Android Studio AI 功能和 Android 开发用例无法与本地模型一起使用。不过,Android Studio 中的 AI 聊天功能通常受本地模型支持。

如需快速准确地了解 Android 开发的各个方面并支持 所有 Android Studio 功能,由 Gemini 模型提供支持的 Android Studio 中的 Gemini是您的最佳解决方案。