Os modelos de linguagem grandes (LLMs) têm capacidades diferentes. Para oferecer controle e flexibilidade no desenvolvimento de software com tecnologia de IA, o Android Studio permite escolher um modelo local, executado na sua máquina pessoal, para ativar a funcionalidade de IA do ambiente de desenvolvimento integrado.

Escolher um modelo

Um modelo local oferece uma alternativa ao suporte de LLM integrado ao Android Studio. No entanto, o Gemini no Android Studio geralmente oferece a melhor experiência de IA para desenvolvedores Android devido aos modelos poderosos do Gemini. Você pode selecionar entre vários modelos do Gemini para suas tarefas de desenvolvimento Android, incluindo o modelo padrão sem custo financeiro ou modelos acessados com uma chave de API paga do Gemini.

A capacidade do modelo local é uma ótima opção se você precisar trabalhar off-line, aderir a políticas empresariais rigorosas sobre o uso de ferramentas de IA ou tiver interesse em experimentar modelos de pesquisa de código aberto.

Testar o modelo Gemma 4

Se você precisar usar um modelo local, recomendamos o Gemma 4, um modelo local de última geração disponível para programação de agentes no Android Studio.

Os requisitos de hardware são os seguintes. Recomendamos o uso do modelo Gemma 26B MoE se você tiver uma máquina de alta performance.

| Modelo | Total de RAM necessária | Armazenamento |

|---|---|---|

| Gemma E4B | 12 GB | 4 GB |

| Gemma 26B MoE | 24 GB | 17 GB |

Consulte o guia de configuração para instruções sobre como baixar e executar o Gemma 4 localmente na sua máquina.

Configurar o suporte ao modelo local

Baixe e instale a versão mais recente do Android Studio.

Instale um provedor de LLM, como o LM Studio ou Ollama, no seu computador local.

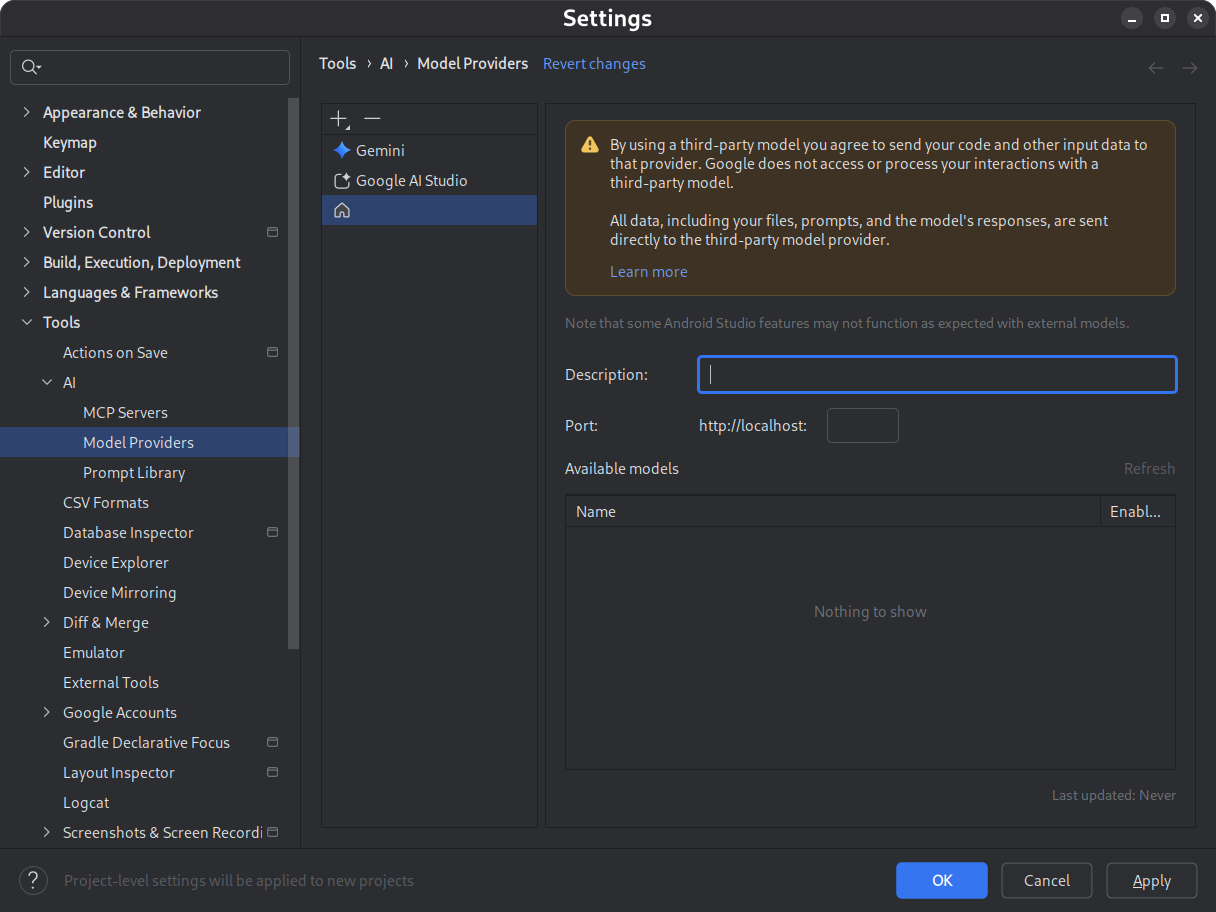

Adicione o provedor de modelo ao Android Studio.

- Acesse Configurações > Ferramentas > IA > Provedores de modelo.

- Selecione o ícone .

- Selecione Provedor local.

- Insira uma descrição do provedor de modelo (geralmente o nome dele).

- Defina a porta em que o provedor está escutando.

- Ative um modelo.

Figura 1. Configurações do provedor de modelo. Baixe e instale um modelo de sua escolha.

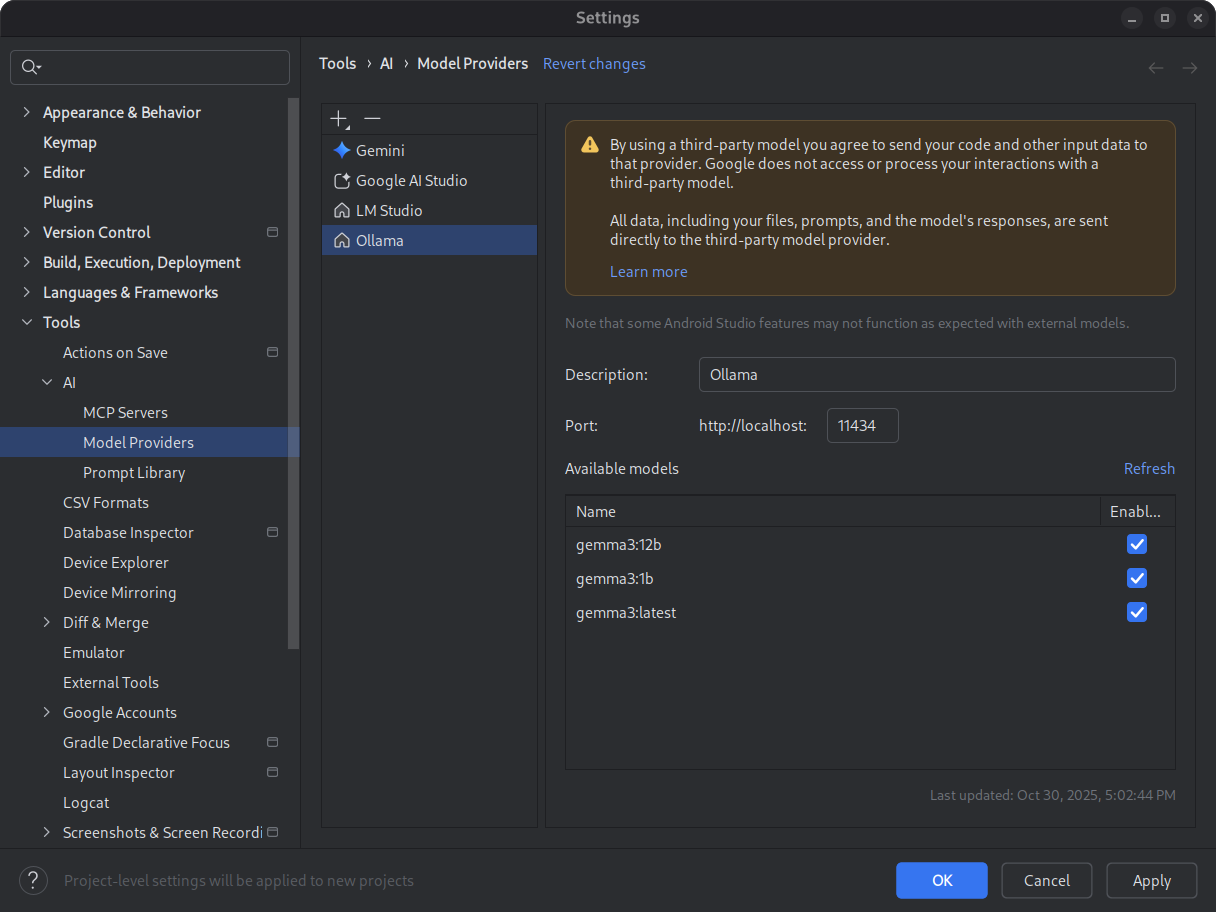

Consulte os catálogos de modelos do LM Studio e Ollama. Para ter a melhor experiência com o modo de agente no Android Studio, selecione um modelo treinado para uso de ferramentas.

Figura 2. Modelos locais disponíveis. Inicie o ambiente de inferência.

O ambiente de inferência veicula seu modelo para aplicativos locais. Configure uma janela de token de tamanho do contexto suficientemente grande para ter desempenho ideal. Para instruções detalhadas sobre como iniciar e configurar seu ambiente, consulte a documentação do Ollama ou do LM Studio.

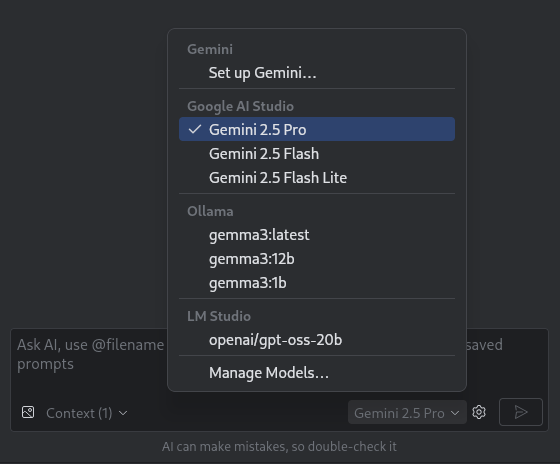

Selecione um modelo.

Abra o Android Studio. Navegue até a conversa no Gemini. Use o seletor de modelos para alternar do modelo padrão do Gemini para o modelo local configurado.

Figura 3. Seletor de modelos.

Depois de conectar o Android Studio ao modelo local, você poderá usar os recursos de conversa no ambiente de desenvolvimento integrado. Todas as interações são totalmente ativadas pelo modelo em execução na sua máquina local, oferecendo um ambiente de desenvolvimento de IA independente.

Considerar limitações de performance

Um modelo local off-line normalmente não tem a mesma performance ou inteligência dos modelos do Gemini baseados na nuvem. As respostas de conversa de modelos locais geralmente são menos precisas e têm latência maior em comparação com modelos baseados na nuvem.

Os modelos locais geralmente não são ajustados para o desenvolvimento Android e podem retornar respostas que não estão informadas sobre a interface do usuário do Android Studio. Alguns recursos de IA do Android Studio e casos de uso de desenvolvimento Android não funcionam com um modelo local. No entanto, o recurso de conversa com IA no Android Studio geralmente é compatível com modelos locais.

Para respostas rápidas e precisas sobre todos os aspectos do desenvolvimento Android e suporte a todos os recursos do Android Studio, o Gemini no Android Studio, com tecnologia dos modelos do Gemini, é a melhor solução.